Die Mixed ANOVA ist ein unverzichtbares Werkzeug in der statistischen Analyse. Sie ermöglicht es, signifikante Unterschiede zwischen den Mittelwerten von zwei oder mehr Gruppen zu prüfen, wenn die Daten wiederholt über die Zeit, Personen oder andere Faktoren gemessen wurden. In diesem Artikel erklären wir ausführlich, wie man eine Mixed ANOVA in SPSS durchführt und wie man die Ergebnisse interpretiert.

Was ist eine ANOVA mit Messwiederholung?

Die Mixed ANOVA ist ein nützliches Werkzeug in der Statistik. Sie hilft festzustellen, ob es signifikante Unterschiede zwischen den Mittelwerten von zwei oder mehr Gruppen gibt. Dies ist besonders nützlich, wenn die Daten mehrmals im Laufe der Zeit, von verschiedenen Personen oder unter verschiedenen Bedingungen gemessen wurden.

In diesem Artikel wird beschrieben, wie man eine Mixed ANOVA in SPSS durchführt und wie man das Ergebnis interpretiert. Zunächst wird jedoch eine kurze Einführung in die Konzepte der Mixed ANOVA gegeben.

Wo kann ich die Beispieldaten herunterladen?

Die Beispieldaten findest du hier: Beispieldaten

Voraussetzungen Mixed ANOVA

- Die abhängige Variableabhängige Variable Die abhängige Variable ist die Variable, die in einer Studie gemessen oder beobachtet wird und die von der unabhängigen Variable abhängig ist. Die unabhängige Variable ist die Variable, die in der Studie manipuliert oder gesteuert wird und die vermutete Ursache für die Veränderungen in der abhängigen Variable ist. ist intervallskaliert. Die ANOVA verwendet aufwändige Rechnungen, für die wir ein entsprechendes SkalenniveauSkalenniveau Das Skalenniveau bezieht sich auf den Typ von Daten, der in einer Studie erhoben wurde, und gibt an, wie die Daten in Bezug auf die Messbarkeit und die Möglichkeit zur Verwendung von Statistiken kodifiziert sind. benötigen (Intervall oder Ratio). Hier ist die Anleitung für Skalenniveaus.

- Innensubjektfaktor ist nominalskaliert. Der Innensubjektfaktor ist die Variable, die die Gruppen voneinander trennt. Beispielsweise die Form der Diät, die Stadt, etc. Diese Variable muss nominalskaliert sein und mindestens drei Gruppen haben. Falls du weniger als drei Gruppen hast, kannst du den t-Test für abhängige Stichproben verwenden.

- Unabhängige Messungenunabhängige Messungen Unabhängige Messungen sind Messungen, die von verschiedenen Beobachtern oder Messverfahren durchgeführt werden und die vermutlich keine Wechselwirkungen oder Verzerrungen durch die Beobachter oder Messverfahren haben. Sie werden verwendet, um die Zuverlässigkeit und Validität von Messungen und Studien zu verbessern und werden häufig in der Psychologie und Sozialwissenschaften verwendet.: die Varianzanalyse vergleicht unterschiedliche Messobjekte, in unserem Fall Versuchspersonen, zu unterschiedlichen Zeitpunkten. Die Gruppen oder Bedingungen (UV) dürfen sich nicht gegenseitig beeinflussen, das heißt, eine Versuchsperson darf sich unter keinen Umständen in mehreren Gruppen zu befinden.

- AusreißerAusreißer Ausreißer sind Datenpunkte, die deutlich von den übrigen Daten abweichen und die Verteilung der Daten beeinflussen können. Sie können aufgrund von Messfehlern, ungewöhnlichen Ereignissen oder menschlichem Fehler auftreten und sollten in der Regel in der Analyse berücksichtigt werden, um sicherzustellen, dass die Ergebnisse valide sind.: Die ANOVA ist empfindlich gegenüber Ausreißern, weshalb der Datensatz auf Ausreißer hin überprüft werden sollte. Bestenfalls gibt es keine Ausreißer in keiner Gruppe. Anleitung für Ausreißer.

- NormalverteilungNormalverteilung Die Normalverteilung, auch Gauss-Verteilung genannt, ist eine Art von Verteilung, bei der die Werte einer Variablen symmetrisch um den Mittelwert angeordnet sind und die Wahrscheinlichkeit, dass Werte in bestimmten Bereichen auftreten, durch eine Glockenkurve dargestellt wird. : die abhängige Variable (Gewicht) in jeder Gruppe sollte so weit wie möglich normalverteilt sein – jedoch nicht zwangsläufig. Das gilt für jede unserer untersuchten Gruppen. Anleitung Test auf Normalverteilung.

- Sphärizität: Die Varianzen zwischen den einzelnen Gruppen sollte gleich sein. Falls die Sphärizität nicht gegeben ist, besteht die Gefahr für einen Fehler 1. Art (α-Fehler, falsch positiv). Das bedeutet, dass wir ein Ergebnis bestätigen, obwohl es nicht wahr. (Ein Patient wird als krank angesehen, obwohl er gesund ist.)

Berechnung der Mixed ANOVA in SPSS

Berechnung der Mixed ANOVA in SPSS

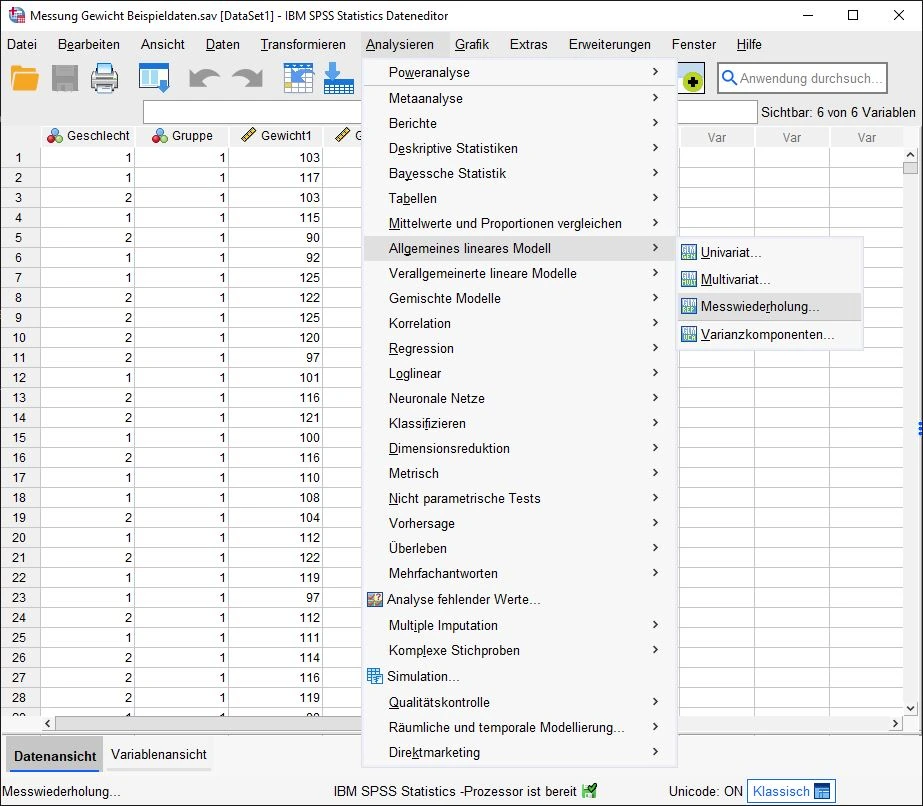

Auswahl Menü in SPSS

Im Menü wählen wir aus: Analyse > Allgemeines lineares Modell > Messwiederholung

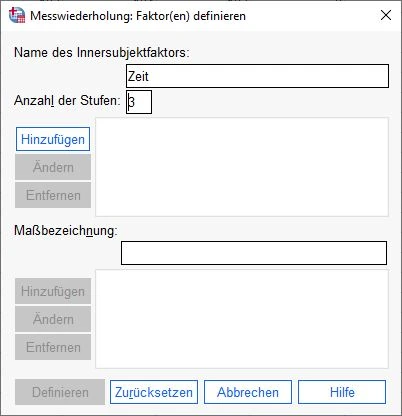

Messwiederholung Faktoren einstellen

Es erscheint das Dialogfenster Messwiederholung: Faktoren definieren. Hier definieren wir den Faktor, der bei einer Messwiederholung „Zeit“ sein kann. In unserem Beispiel haben wir 3 Messzeitpunkte im Datensatz. Daher nennen wir den internen Faktor „Zeit“ und geben für die Anzahl der Schritte den Wert 3 ein.

Anschließend klicken wir auf die Schaltfläche „Hinzufügen„.

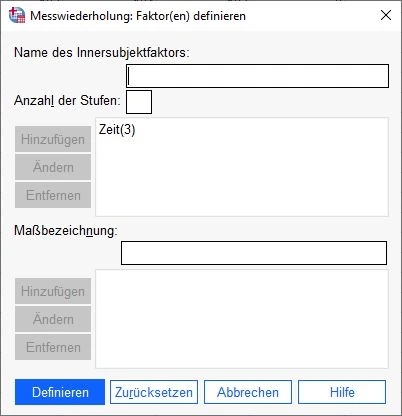

Faktoren definieren in SPSS

Im nächsten Feld wird der Faktor eingegeben. Wir sehen den Eintrag Zeit(3).

Da wir keine weiteren Faktoren definieren wollen, klicken wir auf die Schaltfläche Definieren weiter unten.Messwiederholung Innersubjektvariablen

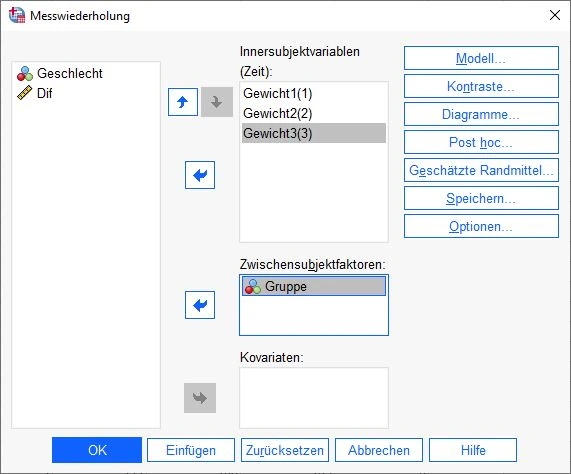

Ein neues Fenster mit mehreren Feldern erscheint. Auf der linken Seite befinden sich alle verfügbaren Variablen unseres Datensatzes. Rechts ist unser Faktor (Zeit) in seine Stufen unterteilt. Jeder Stufe ordnen wir eine Variable aus unserem Datensatz zu. Dazu verschieben wir die jeweilige Variable von links nach rechts.

In unserem Beispiel wandern die Variablen Gewicht 1, Gewicht 2 und Gewicht 3 in dieses Feld.

In unserer Studie wollen wir mehrere Gruppen zu verschiedenen Zeitpunkten messen. Deshalb müssen wir SPSS noch die Variable angeben, die die Gruppen unterteilt. Diese Variable muss nominalskaliert sein. In unserem Beispiel heißt die Variable Gruppe. Diese Variable wird in das Feld Zwischensubjektfaktoren eingefügt.

Im nächsten Schritt klicken wir auf die Schaltfläche „Diagramme„, die sich weiter rechts befindet.

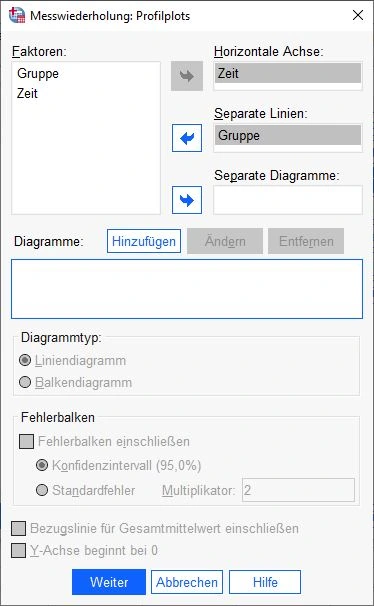

Diagramme: Faktoren wählen

In diesem Feld werden die Diagramme definiert. In das Feld horizontale Achse wird der Faktor (Zeit) eingegeben. Die Variable Gruppe wird in das Feld „Getrennte Linien“ eingegeben.

Dann klicken wir auf die Schaltfläche „Hinzufügen„.

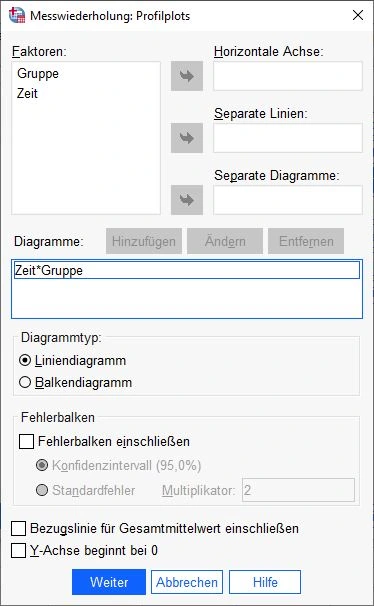

Diagramme: hinzugefügte Diagramme

Die Einstellungen sind übernommen worden. Es erscheint der Eintrag Zeit*Gruppe.

Dann wählen wir Liniendiagramm, die anderen Felder bleiben leer.

Wir übernehmen die Einstellungen und klicken auf „Weiter“.

Auswahl Post HocPost Hoc Post-hoc-Analysen sind Analysen, die nach der Durchführung einer Studie durchgeführt werden, um die Ergebnisse der Studie zu interpretieren und zu vertiefen.

Der nächste Schritt ist der Post-hocPost Hoc Post-hoc-Analysen sind Analysen, die nach der Durchführung einer Studie durchgeführt werden, um die Ergebnisse der Studie zu interpretieren und zu vertiefen.-Test. Klicken Sie auf die Schaltfläche „Post hoc“ auf der rechten Seite.

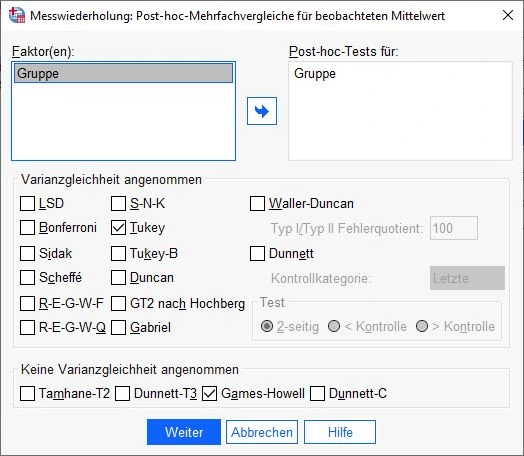

Post hoc Analysen einstellen

Im Fenster ziehen wir unseren Faktor nach rechts, um ihn für einen Post-hoc-Test auszuwählen. In unserem Beispiel verwenden wir die Variable Gruppe.

Dann wählen wir die Testvarianten aus: Tukey und Games-Howell

Wir wählen vorsichtshalber Games-Howell, um die Analyse später durchführen zu können, auch wenn keine Varianzgleichheit angenommen werden kann.

Zur Bestätigung klicken wir unten auf Weiter.

Auswahl geschätzte Randmittel

Als Nächstes wählen wir die Schaltfläche „Geschätzte Randmittel“ im rechten Menü.

Hinweis: In älteren SPSS-Versionen sind die Einstellungen für die geschätzten Randmittel unter der Schaltfläche „Optionen“ versteckt.

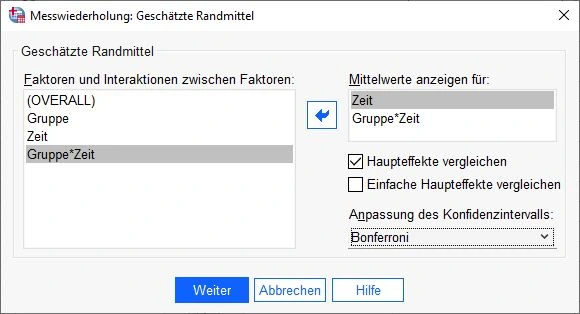

Geschätzte Randmittel einstellen

Im Fenster wählen wir Zeit und Gruppe*Zeit.

Wir setzen ein Häkchen bei „Haupteffekte vergleichen„.

und wählen bei Anpassung des Konfidenzintervalls die Option: „Bonferroni„.Dann klicken wir auf „Weiter„.

Auswahl Optionen

Anschließend wird auf „Optionen“ geklickt.

Optionen auswählen

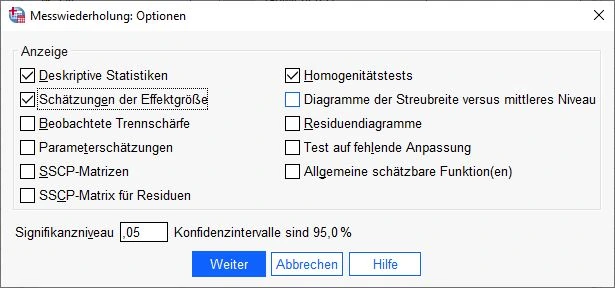

Hier werden die folgenden Optionen ausgewählt:

– deskriptive Statistik

– Effektgrößenschätzungen

– HomogenitätstestsNormalerweise wählen wir für das Signifikanzniveausignifikanzniveau Das Signifikanzniveau, auch als alpha-Niveau bezeichnet, ist der Schwellenwert, der verwendet wird, um zu bestimmen, ob ein Ergebnis in einer Studie statistisch signifikant ist. Es gibt an, wie wahrscheinlich es ist, dass ein bestimmtes Ergebnis oder eine Beobachtung durch Zufall entstanden ist, wenn die Nullhypothese wahr ist. In der Regel wird das Signifikanzniveau auf 0,05 oder 0,01 festgelegt, was bedeutet, dass ein Ergebnis als statistisch signifikant angesehen wird, wenn der p-Wert kleiner als dieser Schwellenwert ist. den Wert: .05

Dann klicken wir auf „Weiter„.

Startklar: Mixed ANOVA in SPSS berechnen

Wir klicken auf „OK“ und starten die Berechnungen. SPSS zeigt die Auswertungen in der Ausgabedatei an, die wir im nächsten Kapitel gemeinsam analysieren werden.

Analyse Mixed ANOVA der SPSS Ergebnisse

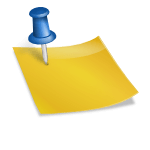

Deskriptive Statistiken

Zunächst schauen wir auf die Tabelle „Deskriptive Statistiken“. Hier werden die Variablen der Messwiederholung in der ersten Spalte aufgezählt. Weitere Spalten sind Mittelwert (Mean), StandardabweichungStandardabweichung Die Standardabweichung ist ein Maß für die Streuung der Werte einer Variablen um ihren Mittelwert und gibt an, wie sehr die Werte von ihrem Durchschnitt abweichen. Sie wird häufig verwendet, um die Varianz innerhalb einer Population oder Stichprobe zu beschreiben und kann verwendet werden, um die Normverteilung einer Variablen zu beschreiben. Eine kleine Standardabweichung bedeutet, dass die Werte der Variablen dicht um ihren Mittelwert clustern, während eine große Standardabweichung darauf hinweist, dass die Werte der Variablen weiter verteilt sind. (SD) und Anzahl der Fälle (N).

Mauchly-Test auf Sphärizität in SPSS

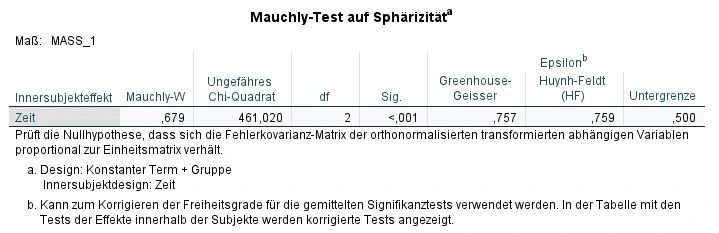

SPSS gibt uns in der Ausgabe die Tabelle Mauchly-Test auf Sphärizität aus. Achte besonders auf die Spalte „Sig.“.

Wenn der Wert unter dieser Spalte kleiner als .05 ist, müssen wir ein Korrekturverfahren anwenden. Aber keine Sorge, SPSS bietet uns drei verschiedene Verfahren zur Auswahl an: Greenhouse-Geisser, Huynh-Feldt und Untergrenze. Diese Werte befinden sich in den rechten Spalten der Tabelle.

Was ist die Sphärizität?

In der Statistik gibt es eine wichtige Annahme namens „Sphärizität„, die insbesondere für eine Methode namens „Mixed ANOVA“ von Bedeutung ist. Dies bedeutet, dass bei einer wiederholten Messung mit mehr als zwei Durchgängen alle Unterschiede zwischen den unabhängigen Variablen gleich sein sollten. Dies wird auch als „HomoskedastizitätHomoskedastizität Homoskedastizität bezieht sich auf die Gleichmäßigkeit der Varianz der Residuen in einem statistischen Modell und bedeutet, dass die Varianz der Residuen über alle Werte der unabhängigen Variablen hinweg konstant ist. Eine Homoskedastizität wird als Vorbedingung für viele statistische Tests und Schätzverfahren angesehen und kann durch eine Gleichmäßigkeit der Streuung der Datenpunkte um die Regressionslinie in einem Scatterplot dargestellt werden.“ bezeichnet.

Um zu überprüfen, ob diese HypotheseHypothese Eine Hypothese ist eine vorläufige Annahme über einen Zusammenhang oder ein Phänomen, die aufgrund von Beobachtungen oder vorherigen Erkenntnissen gemacht wird und überprüft werden kann, indem sie durch Forschung oder Experimente gestützt oder widerlegt wird. erfüllt ist, gibt es einen bekannten Test namens „Mauchly-Test“, der häufig mit dem Programm SPSS verwendet wird. Wenn das Ergebnis dieses Tests einen p-WertP-wert Der p-Wert ist ein Maß für die Wahrscheinlichkeit, dass ein bestimmtes Ergebnis oder eine Beobachtung in einer Studie durch Zufall entstanden ist, wenn die Nullhypothese wahr ist. Er wird verwendet, um zu bestimmen, ob ein Ergebnis statistisch signifikant ist und ob es auf einen wirklichen Unterschied oder eine Beziehung zwischen den Variablen hinweist. Der p-Wert gibt an, wie wahrscheinlich es ist, dass das beobachtete Ergebnis auftreten würde, wenn es tatsächlich keinen Unterschied oder keine Beziehung zwischen den Variablen gibt. Ein niedriger p-Wert bedeutet, dass das Ergebnis wahrscheinlich auf einen Unterschied oder eine Beziehung zurückzuführen ist, während ein hoher p-Wert darauf hinweist, dass das Ergebnis wahrscheinlich auf Zufall zurückzuführen ist. größer oder gleich .05 aufweist, kann man davon ausgehen, dass die Annahme der Sphärizität erfüllt ist. Ist das Ergebnis jedoch signifikant (p < .05), muss die Anzahl der Freiheitsgrade reduziert werden, um Fehler zu vermeiden.

Es ist wichtig zu beachten, dass diese Annahme uns hilft, bessere Ergebnisse zu erzielen und unsere Statistiken richtig zu interpretieren.

In der Statistik gibt es eine Zahl namens „Epsilon (ε)“, die angibt, wie stark die Sphärizität verletzt ist. Je nach Epsilon ist ein anderes Korrekturverfahren anzuwenden. Allerdings gibt es in der Statistik keine einheitlichen Regeln, was genau zu tun ist. Ist der Epsilon-Wert 1, so sind alle Varianzen gleich, das heißt es liegt Homoskedastizität vor.

| Korrektur | Verwenden wenn |

|---|---|

| Huynh-Feld | ε > .75 |

| Greenhouse-Geisser | ε <= .75 |

In unserem Beispiel ist ε = .757 und wir verwenden die Huynh-Feld-Korrektur

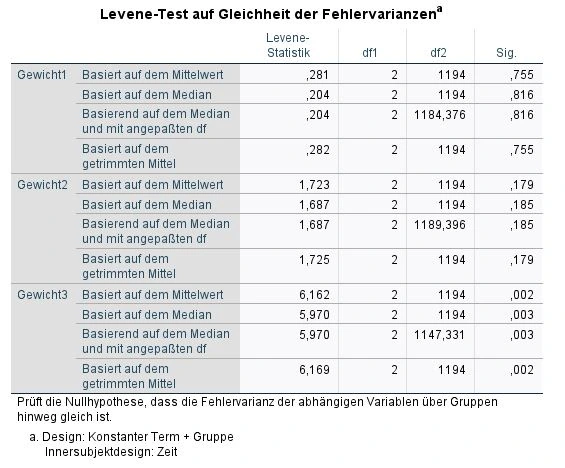

Levene-Test auf Gleichheit der Fehlervarianzen

In der Statistik benötigen wir oft Homoskedastizität, d.h. die Gleichheit der Varianzen in vielen Fällen. In diesem Artikel werden wir uns zwei Tests von SPSS ansehen und erklären, wie sie zu interpretieren sind. Der erste Test ist der Levene-Test, der prüft, ob die Varianzen der ResiduenResiduen Residuen sind die Abweichungen zwischen den beobachteten Daten und den durch ein statistisches Modell vorhergesagten Daten und werden verwendet, um die Anpassung des Modells an die Daten zu beurteilen und um mögliche Muster oder Trends in den Daten zu erkennen. Sie können auch verwendet werden, um die Validität und Zuverlässigkeit von Vorhersagemodellen zu überprüfen. gleich sind. Der zweite Test ist der Box-Test, der die Gleichheit der Kovarianzmatrix prüft.

Aus diesem Grund blicken wir auf die Tabelle „Levene-Test auf Gleichheit der Fehlervarianzen„

In der rechten Spalte sehen wir die Signifikanzen (Sig.). Falls ein Wert unter .05 ist, sind die Werte signifikant. In diesem Fall sollten die Werte nicht interpretiert werden. In unserem Beispiel ist das bei den Messungen der Variable „Gewicht3“ der Fall. Damit ist die Interpretation der gesamten ANOVA zumindest so nicht mehr möglich.

In diesem Fall müssen wir unsere Interpretation anpassen und einen Fokus auf die Post-Hoc Analysen setzen. Die Post-Hoc-Vergleiche gelten als unabhängig von der ANOVA.

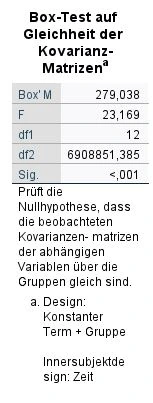

Box-Test auf Gleichheit der KovarianzKovarianz Die Kovarianz ist ein Maß für den Zusammenhang zwischen zwei oder mehr Variablen, das angibt, wie sehr sich die Werte der Variablen im Verhältnis zueinander ändern und kann verwendet werden, um die Streuung der Daten zu beschreiben.-Matrizen

Nachdem wir geprüft haben, ob die Varianzen gleich sind, prüfen wir nun, ob die Kovarianzmatrizen gleich sind. Dazu verwenden wir den Box-Test, der in der SPSS-Tabelle „Box-Test auf Gleichheit der Kovarianzmatrizen“ zu finden ist.

Es ist wichtig zu beachten, dass die PowerStatistische Power Statistische Power ist die Wahrscheinlichkeit, dass ein statistisches Testverfahren einen wirklich vorhandenen Unterschied zwischen zwei Gruppen oder Bedingungen erkennen wird. Eine hohe statistische Power bedeutet, dass das Testverfahren empfindlich genug ist, um kleine Unterschiede zu erkennen, während eine niedrige statistische Power dazu führen kann, dass wichtige Unterschiede übersehen werden. Es ist wichtig, dass die statistische Power bei der Planung einer Studie berücksichtigt wird, um sicherzustellen, dass das Testverfahren ausreichend empfindlich ist, um wichtige Unterschiede zu erkennen. des Box-Tests von der Anzahl der Fälle und der Normalverteilung der Daten abhängt. Je höher die Fallzahl, desto schneller wird der Test signifikant. Einige Statistikexperten empfehlen daher, den Box-Test nicht bei einem Signifikanzniveau von .05 zu testen, sondern deutlich strengere Werte wie .025 oder .01 oder sogar bei .001 zu verwenden.

Die Interpretation der Box-Test-Tabelle ist ähnlich wie beim Levene-Test. Ist der Wert in der Zeile Signifikanz (Sig.) kleiner als .05 (oder einer der anderen angegebenen Werte), bedeutet dies, dass die Kovarianzmatrizen nicht gleich sind und die Voraussetzung nicht erfüllt ist. Ist der p-Wert größer als .05, so sind die Kovarianzmatrizen gleich und die Voraussetzung ist erfüllt.

In unserem Beispieldatensatz sin die Werte signifikant p<.001. Aus diesem Grund sin die Voraussetzung nicht erfüllt.

Ergebnisse publizieren

Der Box-Test auf Gleichheit der Kovarianz-Matrizen war nicht gegeben (p<.001).

Was tun bei Nichterfüllung?

- Wir berechnen mit dem Datensatz eine ANOVA mit Messwiederholung

- Wir berechnen die mixed ANOVA und berichten von den fehlenden Voraussetzungen

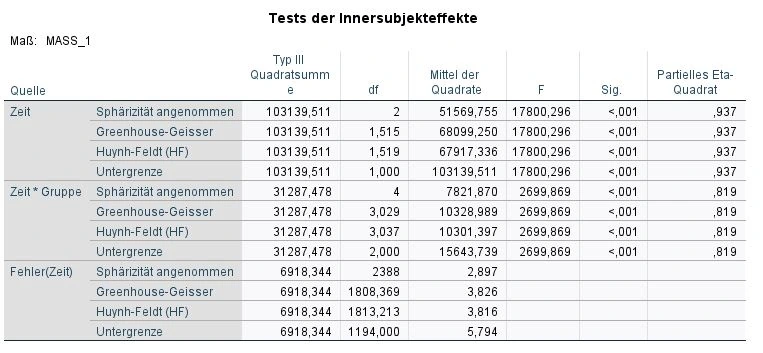

Test der Innersubjekteffekte

Als nächstes prüfen wir die Innersubjekteffekte und blicken auf die entsprechende Tabelle. Uns interessiert die Zeile Zeit*Gruppe. Das heißt wir wollen wissen, welchen Interaktionseffekt wie die beiden Variablen haben.

Welche Zeile wir wählen ist abhängig von unserem Mauchly-Test auf Sphärizität. Wir interpretieren die Ergebnisse entweder als „Sphärizität angenommen“, „Greenhouse-Geisser“ oder „Huynh-Feldt“. In unserem Fall mussten wir wegen der fehlenden Sphärizität eine Korrektur nach Huynh-Feldt vornehmen, wie im oberen Kapitel besprochen. Wir schauen auf die Spalte Signifikanz (Sig.) und sehen, dass die Signifikanz beim Huynh-Feld (HF) bei Zeit*Gruppe bei p<.001 ist.

Wenn der Wert unter .05 ist, ist eine Signifikanz gegeben und wir haben einen Interaktionseffekt.

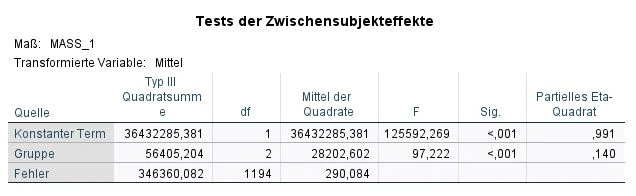

Test der Zwischensubjekteffekte

F(df bei Zeit*Gruppe, df bei Fehler(Zeit))=F-Wert, Sig., Partielles Eta-Quadrat

F(3.04, 1813.21) = 2699.97, p <.001, η² = .819

Ergebnisse publizieren

In dieser Studie wurde ein signifikanter Interaktionseffekt zwischen Zeit und Gruppe festgestellt. Aufgrund nicht gegebener Sphärizität wurde eine Huynh-Feldt-Korrektur angewandt und führte zu folgendem F-Test F(13.98, 649.99) = 10.07, p < .001, partieller η² = .18.

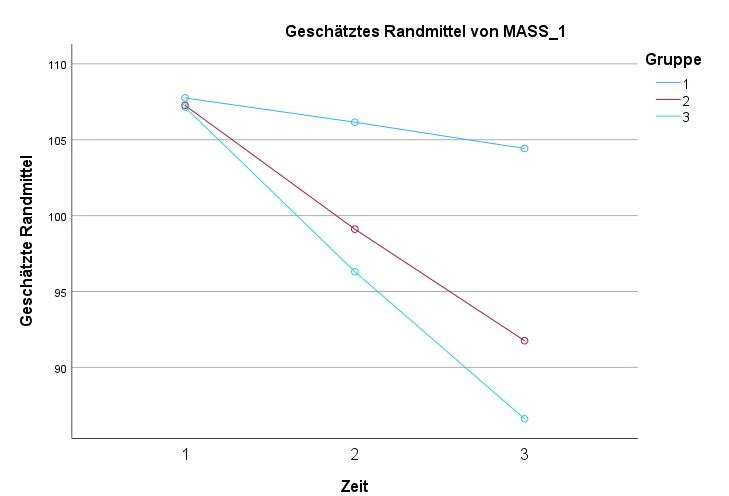

Diagramm der Interaktionseffekte

Über mich: Dr. Peter Merdian

Experte für Neuromarketing und Data Science

Hallo, mein Name ist Peter Merdian und Statistic Hero ist mein Herzensprojekt, um Menschen zu helfen, einen einfachen Einstieg in die Statistik zu finden. Ich hoffe, die Anleitungen gefallen dir und du findest nützliche Informationen! Ich habe selbst in Neuromarketing promoviert und liebe datengetriebene Analysen. Besonders mit komplexen Zahlen. Ich kenne aus eigener Erfahrung alle Probleme, die man als Studierender während des Studiums hat. Deshalb sind die Anleitungen so praxisnah und einfach wie möglich gehalten. Fühl dich frei, die Anleitungen mit deinen eigenen Datensätzen auszuprobieren und spannende Ergebnisse zu berechnen. Ich wünsche dir viel Erfolg bei deinem Studium, deiner Forschung oder deiner Arbeit.

Möchtest du mir Feedback geben oder mich kontaktieren?

Bitte hier: Dr. Peter Merdian LInkedIn